【大纪元2022年06月09日讯】(大纪元记者林倩玉台湾新竹报导)AI人工智慧也会种族歧视?清华大学资工系助理教授郭柏志与麻省理工学院、哈佛大学跨国研究发现,当采用先进的AI深度学习算法来判读X光片及电脑断层扫描时,电脑竟可以从这些医学影像分辨出患者是黑人、白人或亚洲人,并影响判断的准确率。科学家迄今还不明白AI是如何办到的。

郭柏志指出,医界近年大量引进人工智慧,研发医疗机器人、智慧诊疗、及医学影像识别技术等,协助医生更快速、准确地诊断,这本该是造福病患的好事;但这项研究也揭露其中的隐忧,提醒我们应该注意医疗伦理问题,并消弭引进人工智慧产生的医疗不平等现象。

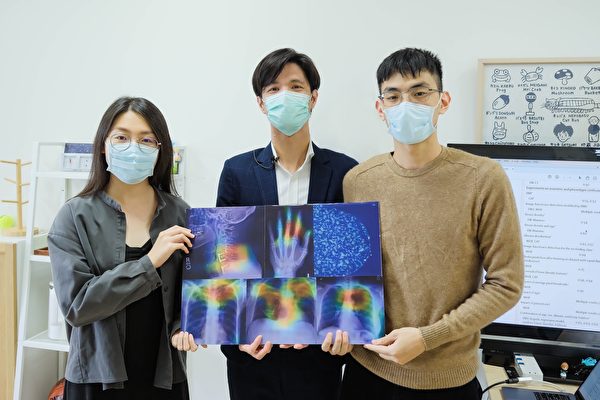

这项横跨4国的跨国研究团队,还包括了史丹佛大学、多伦多大学等,与美国国家卫生院合作,分析超过20万位病患的胸部、颈椎、手部X光及胸部电脑断层扫描,揭露人工智慧也有歧视问题的惊人真相。这项研究成果最近登上了国际顶尖期刊《刺胳针数位健康》(Lancet Digital Health),并吸引外媒的重视报导。

美国食品药物管理局(FDA)目前已核准医院采用人工智慧辅助判读X光片及电脑断层扫描等医学影像,人工智慧的深度学习系统可帮助电脑针对大量资料自我训练,并发展出辨识模型。研究团队发现,人类放射师无法从X光片判断出患者的种族,但AI却能轻易做到,且准确率高达9成。

团队中一名哈佛大学教授表示,当团队成员告诉他AI可以从X光片来判断人种,他简直不敢置信,认为这真的太疯狂,一定是哪里出错了。当愈来愈多的证据浮现,有团队成员则直言感觉很“恐怖”。

郭柏志表示,团队本来猜想AI可能是从骨质密度来判断人种,因黑人的骨质密度高于白人,但后来发现并非如此。郭柏志出示一张手掌的X光片,显示AI判读人种的重点聚焦在中指与食指的第三指节,团队里也有二、三十年经验的放射科医师,但实在想不出来AI是怎么判读出人种的。

更令研究团队忧心的是,人工智慧的种族歧视也影响了医学影像判读的准确率。郭柏志表示,研究发现白人的医学影像有问题却没被检查出来的误判率是17%,但黑人的误判率却高达28%,相差超过10个百分点。而医学影像的误判也会进一步影响急诊、医疗给付等资源分配。

郭柏志说,我们原来以为人类才会歧视,电脑应该是最公平的,但没想到电脑也默默地提取了人类没教它的资讯,包括人种及性别等,如何去除歧视,让各族群的医学影像判读都有一致的准确率,是我们下一阶段要努力的目标。

责任编辑:王愉悦